最初に

ChatGPTやGitHub Copilotを使ってはいますが、ローカルで動作する環境を作るのは初めてです。

Ollamaを使用するのも初めてなので、何かおかしな事を言っていたらスルーするか突っ込んでくれると助かります。

動作環境

CPU:Ryzen7950X3D

GPU:NVIDIA RTX5070TI(16GB)

メモリ:64GB

OS:Windows11

AIモデル:gpt-oss-20b/gpt-oss-120b

Ollamaのインストール

Ollama公式サイト(https://ollama.com)の「Download」を選択。

Windowsを選択して「Download for Windows」を押下。ダウンロードされたファイルをダブルクリックしてインストール。

gpt-oss-20bモデルのダウンロード

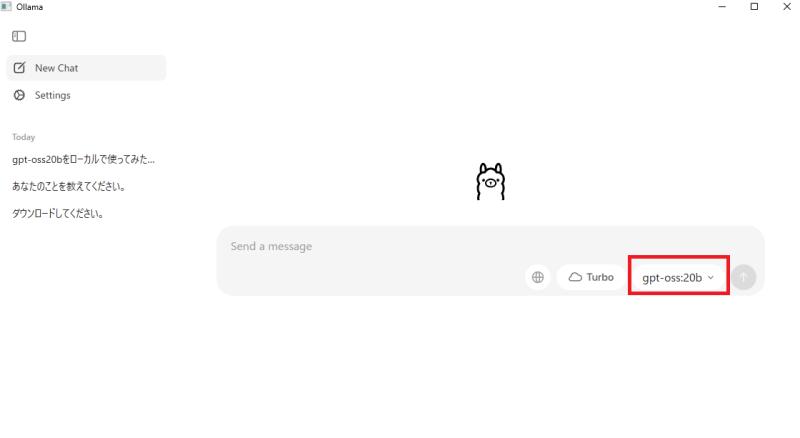

Ollamaを起動し、画像の赤枠部分でgpt-oss:20bを選択した状態でチャット欄に何か入力すると、モデルが自動的にダウンロード、インストールされ、入力に対して回答されます。簡単。

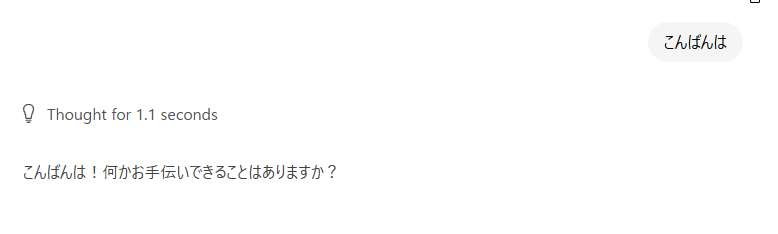

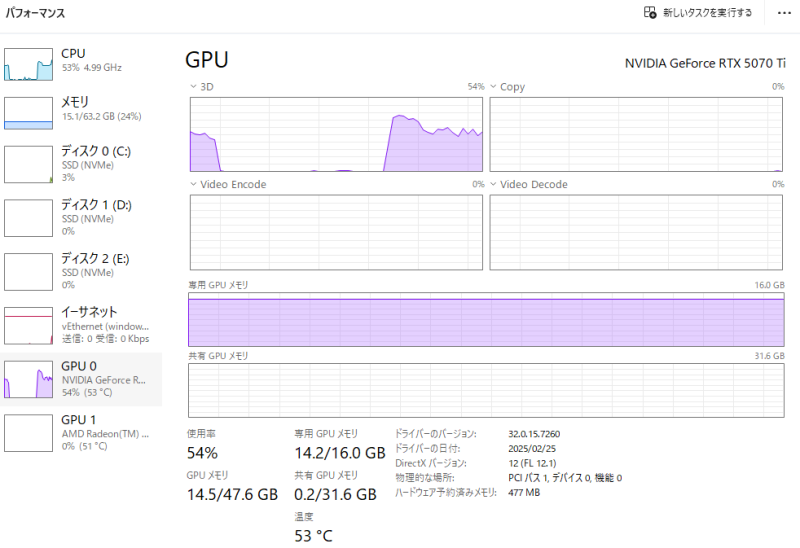

gpt-oss-20bの動作確認

とりあえずモデルに自分自身のことを質問して動作確認。

AIが回答中のタスクマネージャーの様子。

巷では「gpt-oss-20bはGPUのメモリが16.0GBでも動く」という話をされていますが、私が動作確認した範囲だと、「動作はするが、GPUのメモリだけではメモリ不足、足りない分はシステムメモリも使用して動作する」というのが正しいように見えます。

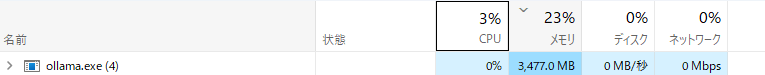

Ollama起動直後のメモリ使用量

質問に回答した後のメモリ使用量、GPUメモリとあわせて概ね20Gに届かない程度のメモリが使われている模様です。

gpt-oss-120bモデルのダウンロード

思いがけず、あっさりと動作してくれたのと、GPUメモリが不足した分システムメモリを使ってくれるなら120bも動くのでは・・・?との疑問から120bモデルも試してみました。

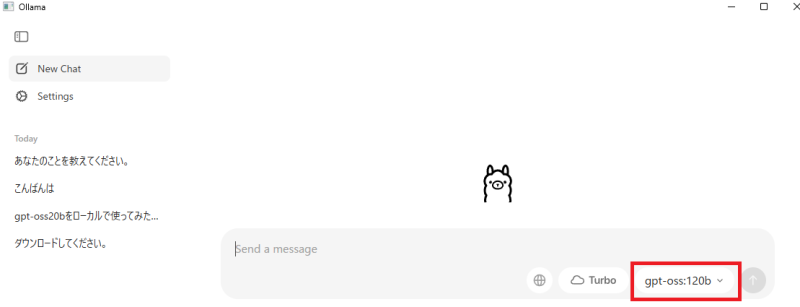

赤枠部分で「gpt-oss:120b」を選択して質問するだけ、簡単。

gpt-oss-120bの動作確認

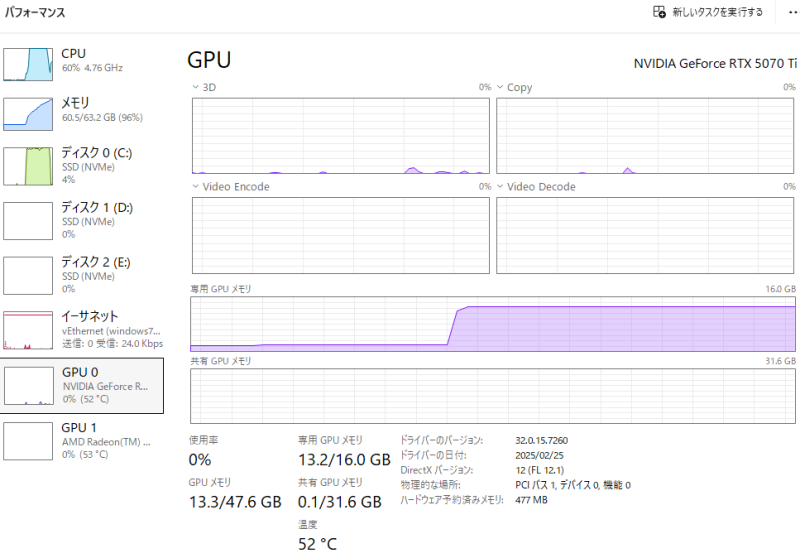

質問して少し時間がたってもメモリ使用量が増えていくばかりでGPUの計算処理は行われていません。

メモリが不足していてモデルを展開しきれないのが原因と思われます。

システムメモリもぐわっと使用量が増えているため、おそらくGPUメモリに展開しきれなかった分をシステムメモリに展開しようとしているのだろうな・・と思います。

※GPUメモリに展開するためにシステムメモリを一時的な置き場にしている?とも思いましたが、そうすると20b使用時に4Gに届かない程度しかシステムメモリを使っていないのもおかしいので、おそらくシステムメモリに展開しているものと思われます。

質問の応答はエラーになりました。

終わりに

というわけで、メモリ16GBのグラフィックカードでも動作はするが、GPUメモリだけではメモリが不足してシステムメモリも使用されている、という結論になりました。

120bについてはまともに動作しませんでしたが、システムメモリを128GBに増設したら動いてくれるのかもしれません。

とりあえずローカルモデルを動作させる、というところまでできたので、Pythonを勉強しつつ、次は提督らしくRAGで艦これの知識を与えてみようかな、などと考えています。

コメント